停不下来!DeepSeek 再“开源” V3/R1 推理系统

Max 是万万没想到,以为 DeepSeek 的开源周活动是在昨日结束的。没想到今天 12 点多 DeepSeek 继续在推上“开源”了。

这是一种什么感觉?

这就像在演唱会上,乐队说演出结束了,但观众们热情鼓掌,于是他们“即兴”决定再演一首歌!

🚀 开源周第六天:还有一件事:DeepSeek-V3/R1 推理系统概述

通过以下方式优化吞吐量和延迟:

- 🔧 跨节点 EP 驱动的批量扩展

- 🔄 计算-通信重叠

- ⚖️ 负载均衡

DeepSeek 在线服务的统计数据:

- ⚡ 每个 H800 节点每秒处理 73.7k/14.8k 输入/输出令牌

- 🚀 成本利润率 545%

💡 我们希望本周的见解能为社区带来价值,并为我们共同的 AGI 目标做出贡献。

如何理解 DeepSeek-V3/R1 的推理系统

想象一个高科技厨房,顶级大厨(GPU)们正在施展烹饪魔法。DeepSeek-V3/R1 的推理系统就像一个完美协调的团队,以闪电般的速度端上 AI 大餐。

以下是它的工作原理:

🔧 跨节点专家并行(EP)

想象一群专业厨师,每位都在精进自己的招牌菜(专家)。他们在不同工作站(节点)间协作,无缝传递食材(数据),轻松处理大量订单(批次)。团队合作让梦想成真!

🔄 计算-通信重叠

当一位厨师在切菜和备餐(计算)时,另一位厨师从储藏室取食材(通信)。没有停歇,只有流畅的省时多任务处理,就像在主菜烤制的同时准备甜点。

⚖️ 负载均衡

任务被均匀分配,因此没有厨师会忙得不可开交,而其他人却闲着。就像为每个厨房岗位安排恰到好处的人手,确保晚餐高峰期的完美运作。

数据说明一切:

⚡ 每个 H800 节点每秒处理 73.7k 输入令牌或 14.8k 输出令牌,速度快到你说“上菜!”之前就完成了!

📷 545% 的成本利润率,证明你可以提供顶级 AI 服务,而不会让钱包破产。

DeepSeek 不仅在做菜,还在分享食谱!

DeepSeek 成本利润率 545% 是怎么来的?

所有 DeepSeek-V3/R1 推理服务均在 H800 GPU 上运行,精度与训练保持一致。具体来说,矩阵乘法和调度传输采用与训练对齐的 FP8 格式,而核心 MLA 计算和组合传输使用 BF16 格式,以确保最佳服务性能。

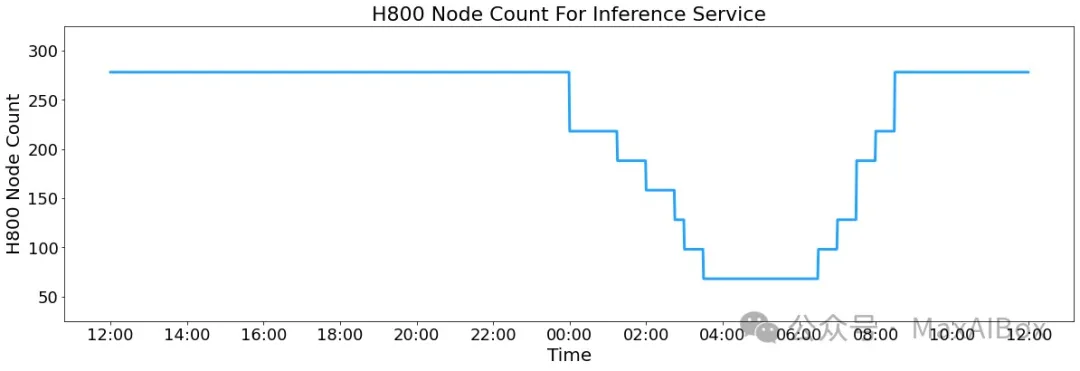

此外,由于白天服务负载高而夜间负载低,DeepSeek 实施了一种机制:在白天高峰时段,所有节点都部署推理服务;在夜间低负载时段,减少推理节点并将资源分配给研究和训练。

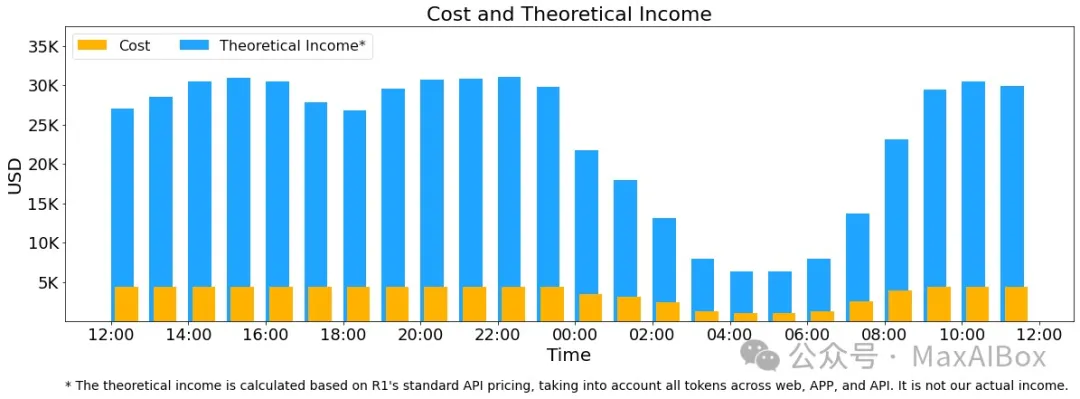

在过去 24 小时内(UTC+8 2025 02/27 12:00 PM 至 2025 02/28 12:00 PM),V3 和 R1 推理服务的峰值节点占用总数达到 278,平均占用节点数为 226.75(每个节点包含 8 个 H800 GPU)。假设一个 H800 GPU 的租赁成本为每小时 2 美元,则每日总成本为 87,072 美元。

在 24 小时统计期内(UTC+8 2025 02/27 12:00 PM 至 2025 02/28 12:00 PM),V3 和 R1:

- 总输入令牌数:608B,其中 342B 令牌(56.3%)命中磁盘 KV 缓存。

- 总输出令牌数:168B。平均输出速度为每秒 20–22 令牌,每个输出令牌的平均 kvcache 长度为 4,989 令牌。

- 每个 H800 节点在预填充期间的平均吞吐量为 ~73.7k 令牌/秒(包括缓存命中),在解码期间为 ~14.8k 令牌/秒。

以上统计数据包括来自网页、APP 和 API 的所有用户请求。如果所有令牌均按 DeepSeek-R1 的定价计费(*),则每日总收入为 562,027 美元,成本利润率为 545%。

(*)R1 定价:

- 输入令牌(缓存命中):$0.14/M

- 输入令牌(缓存未命中):$0.55/M

- 输出令牌:$2.19/M

不过,DeepSeek 表示实际收入远低于此,原因如下:

- DeepSeek-V3 的定价显著低于 R1;

- 只有部分服务被商业化(网页和 APP 访问仍然免费);

- 夜间非高峰时段自动应用折扣。

震惊四座

DeepSeek 今天公布的数据,让网友们大为震惊了。

网友感叹:

“成本利润率 545%” 等等,所以你是说 OpenAI 在抢钱咯?

DeepSeek 545% 的利润率让我感觉 OpenAI 简直是在抢钱!如果 DeepSeek 按照 OpenAI 对 GPT-4.5 的定价来算,一个 H800 节点每秒可以产生大约 7 美元的收入!

这是一份绝妙的礼物;它真的会将所有小团队推向一个新的高度;感谢你们,优秀的 OpenAI 团队。

我们都期待着在未来几周内看到 V4 和 R2 的发布。

希望我们还能看到一款超越当前模型的图像模型,以及一款超越 Veo2 的视频模型。

梁文锋:我们只是不小心成了一条鲶鱼

今天 DeepSeek 公开了成本利润率,让 Max 想起就在前几天 DS 还宣布降价,大幅下调 API 调用价格。

2024 年 5 月,DeepSeek V2 模型发布后迅速引发一场血雨腥风的大模型价格战,有人说 DeepSeek 是行业的一条鲶鱼。

梁文锋后来在采访中表示,

我们不是有意成为一条鲶鱼,只是不小心成了一条鲶鱼。

……

我们只是按照自己的步调来做事,然后核算成本定价。我们的原则是不贴钱,也不赚取暴利。这个价格也是在成本之上稍微有点利润。

DeepSeek 开源周系列:

© 版权声明

文章版权归作者所有,未经允许请勿转载。